机器学习绪论

机器学习 绪论

机器学习三观:what,why,how

- what:什么是机器学习?

- why:为什么要机器学习?

- how:怎样学机器学习?

what:什么是机器学习?

一类能从数据中学习出其中背后潜在规律的算法

深度学习指的是神经网络哪一类学习算法,因此是机器学习的子集

why:为什么要学机器学习

- 从事机器学习理论研究

- 从事机器学习系统开发

- 将算法迁移应用到自己的研究领域

- 从事应用方向研究:NLP,CV,LLM等

how:怎样学机器学习?

从事理论研究

- 西瓜书学好

将算法迁移到自己的研究领域

从事应用方向研究

机器学习的诞生 就是为了解决实际问题而诞生的

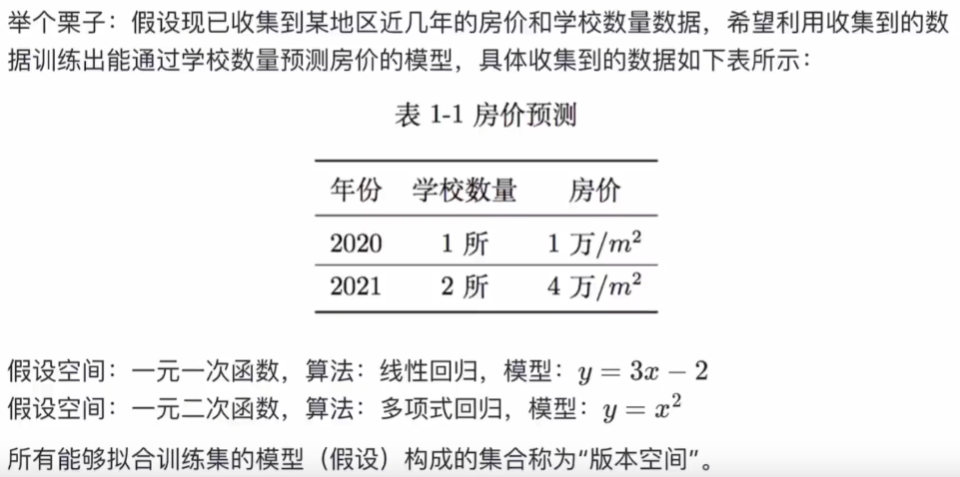

“算法”是指从数据中学得“模型”的具体方法 比如线性回归,对数几率回归,决策树等

”算法“产出的结果称为”模型“;通常是具体的函数或者可抽象地看作为函数,例如一元线性回归算法产出的模型即为形如

基本术语

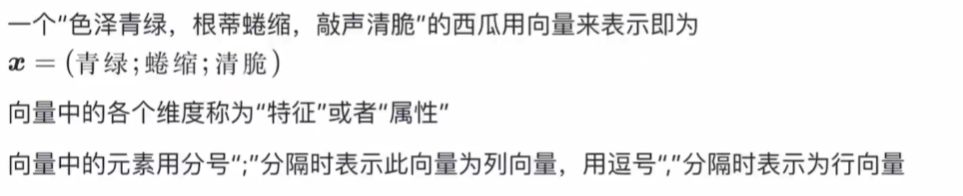

样本:也称为”示例“,是关于一个事件或对象的描述

特征工程是指从原始数据转换为特征向量的过程。

标记:机器学习的本质就是在学习样本的某个方面的表现是否存在潜在的规律,我们称该方面的信息为“标记”

标记通常也看为样本的一部分,因此,一个完整的样本通常表示为(x,y)

样本空间:也称为“输入空间”或”属性空间”。由于样本采用的是标明各个特征取值的”特征向量”来进行表示,根据线性代数的知识可知,,有向量便会有向量所在的空间,因此称表示样本的特征向量所在的空间为样本空间,通常用花式大写的X表示

标记空间︰标记所在的空间称为“标记空间”或”输出空间”,数学表示为花式大写的y

根据标记的取值类型不同,可将机器学习任务分为以下两类:

- 当标记取值为离散型时,称此类任务为“分类”,例如学习西瓜是好瓜还是坏瓜、学习猫的图片是白猫还是黑猫等。当分类的类别只有两个时,称此类任务为”二分类“,通常称其中一个为”正类”,另一个为”反类”或”负类”;当分类的类别超过两个时,称此类任务为”多分类”。由于标记也属于样本的一部分,通常也需要参与运算,因此也需要将其数值化,例如对于二分类任务,通常将正类记为1,反类记为0,即y={0,1}。这只是一般默认的做法,具体标记该如何数值化可根据具体机器学习算法进行相应地调整,例如第6章的支持向量机算法则采用的是J= {-1,+1}·

- 当标记取值为连续型时,称此类任务为“回归“,例如学习预测西瓜的成熟度、学习预测未来的房价等。由于是连续型,因此标记的所有可能取值无法直接罗列,通常只有取值范围,回归任务的标记取值范围通常是整个实数域R,即y=R。

根据是否有用到标记信息,可将机器学习任务分为以下两类:

模型训练阶段有用到标记信息时,称此类任务为“监督学习”,例如第3章的线性模型。

在模型训练阶段没用到标记信息时,称此类任务为”无监督学习”,例如第9章的聚类

数据集∶数据集通常用集合来表示,令集合D={$x_1,x_2,…,x_m$}表示包含m个样本的数据集,一般同一份数据集中的每个样本都含有相同个数的特征,假设此数据集中的每个样本都含有d个特征,则第i个样本的数学表示为d维向量$x_i$=($x_{i1};x_{i2};…;x_{id}$),其中$x_{ij}$表示样本$x_i$在第$x_j$个属性上的取值。

泛化∶由于机器学习的目标是根据已知来对未知做出尽可能准确的判断,因此对未知事物判断的准确与否才是衡量一个模型好坏的关键,我们称此为”泛化”能力。

分布:此处的“分布”指的是概率论中的概率分布,通常假设样本空间服从一个未知“分布”D,而我们收集到的每个样本都是独立地从该分布中采样得到,即”独立同分布”。通常收集到的样本越多,越能从样本中反推出D的信息,即越接近真相。

数据决定模型的上限,而算法则是让模型无限逼近上线